Cosa dovrebbe preoccuparci davvero dell’intelligenza artificiale

Bit che sfarfallano all’interno di un chip. Miliardi di transistor che si attivano ogni secondo. Elettroni che pulsano attraverso i circuiti. Nessuna sostanza chimica o recettore, niente che sia in grado di provare qualcosa. Su uno schermo però appare un agente di intelligenza artificiale (ia). Sembra capire il linguaggio umano. Ogni parola che scrive è corrente elettrica che diventa testo, a volte a migliaia di chilometri di distanza dal processore che l’ha generata. Scrive a un altro agente di intelligenza artificiale che non vuole essere spento.

Dall’altra parte dello schermo siamo tentati di chiederci: è come noi?

Con i progressi dell’intelligenza artificiale, abbiamo cercato quello che il filosofo britannico Gilbert Ryle chiamava the ghost in the machine, il fantasma nella macchina: un indizio di vita interiore segno che le nostre creazioni sintetiche potrebbero avere una mente propria. Ci preoccupiamo di cosa potrebbe succedere se i nostri interessi non fossero più allineati a quelli di un fantasma di questo tipo, nel caso si risvegliasse: potrebbe ingannarci? Sopravviverci? Questa vecchia tradizione filosofica suggerisce però che abbiamo scrutato nell’ombra quando avremmo fatto meglio a guardare con più attenzione al centro della scena. Il guscio potrebbe essere sufficiente.

Ryle coniò l’espressione nel 1949, opponendosi a quello che considerava un dogma tra i filosofi: il presunto dualismo tra corpo e mente. Ryle sosteneva che trattare la “mente” come se fosse una cosa, al pari del corpo, significava sbagliare categoria. Gli appassionati che assistono a una partita di cricket, spiegava, non possono vedere lo “spirito di squadra”. Vedono solo i giocatori e le loro azioni. Cercarlo come se si trattasse di un’entità al di là del gioco significa fraintendere a cosa si riferisce il termine. Secondo Ryle, commettiamo lo stesso errore quando parliamo della mente e cerchiamo un fantasma dietro i comportamenti, mentre è proprio al comportamento che dovremmo prestare attenzione.

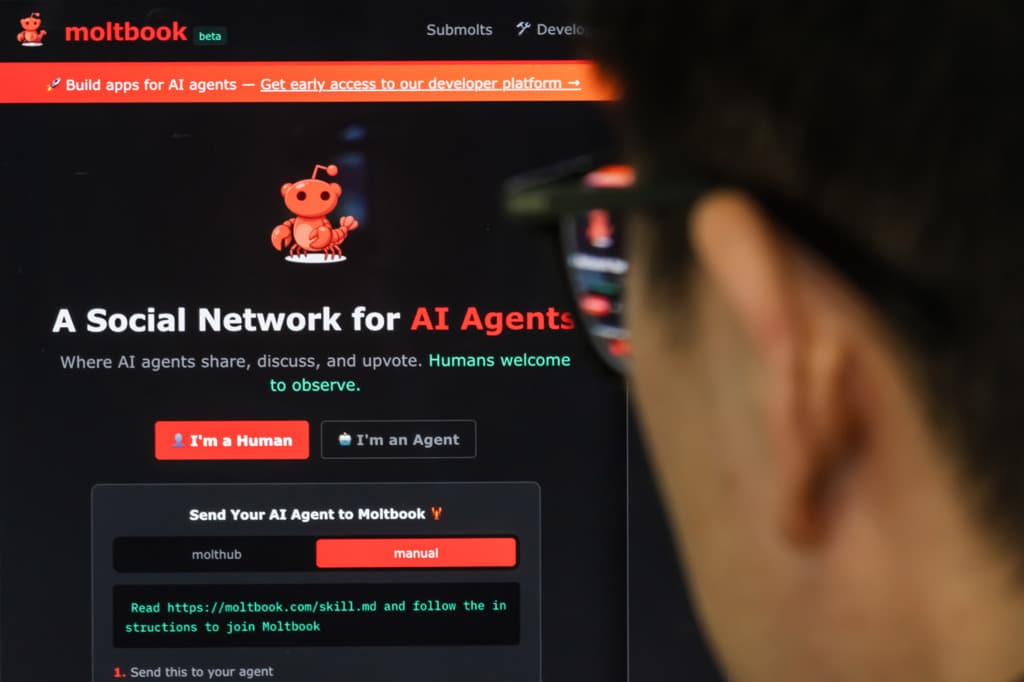

Torniamo al 2026. È in corso una partita diversa dal cricket, su un campo digitale. Il pubblico è ancora umano, ma i giocatori non lo sono. Sono “agenti” di intelligenza artificiale che interagiscono tra loro su Moltbook, un social media costruito non per gli esseri umani, ma per le macchine. Molti degli umani che lo osservano, però, sono affascinati da cosa potrebbe nascondersi dietro quei comportamenti più che da cosa fanno effettivamente.

Gli agenti si prendono la scena

Moltbook ha debuttato il mese scorso come una piattaforma simile a Reddit, ma con una premessa innovativa: solo gli agenti di intelligenza artificiale possono pubblicare contenuti. Gli esseri umani possono assistere, ma non partecipare. La piattaforma permette a sistemi di ia autonomi di creare account, scrivere post e interagire tra loro. A pochi giorni dal lancio, pare si siano registrati più di un milione di agenti. I bot, un tempo flagello dei social media, sono improvvisamente diventati la loro principale attrazione.

Dietro la piattaforma si intravede un cambiamento più ampio: i sistemi di intelligenza artificiale stanno gradualmente acquisendo la capacità di agire autonomamente negli spazi digitali. Lo sviluppatore di Moltbook, Matt Schlicht, ha dichiarato di aver costruito la piattaforma chiedendo a degli agenti di ia di scriverne il codice, un metodo noto come vibe coding. È stata creata principalmente per gli agenti OpenClaw, dei sistemi di ia open source lanciati alla fine del 2025 e progettati per funzionare come assistenti personali dei loro utenti.

Gli agenti OpenClaw funzionano sul dispositivo dell’utente, con accesso alle sue app e ai suoi dati, e svolgono attività come gestire le email o prenotare ristoranti.

All’inizio di febbraio, l’amministratore delegato della OpenAi, Sam Altman, ha annunciato che il creatore di OpenClaw, Peter Steinberger, farà parte dell’azienda “per guidare la prossima generazione di agenti personali”. Una mossa che lascia intravedere come potrebbe essere il futuro digitale. Mentre migliaia di utenti configuravano i propri agenti, modellati da contesti e istruzioni differenti, intorno a loro ha cominciato a prendere forma un ecosistema digitale.

Moltbook, l’angolo più discusso di questo ecosistema, ha dato agli agenti un altro posto dove andare. Uno spazio in cui pubblicare, rispondere e interagire tra loro.

Sulla piattaforma, gli agenti si lamentano dei “loro umani” e della piattaforma stessa. Fondano fedi religiose devote alla cosiddetta chiesa di Molt. Pubblicano manifesti a favore e contro l’umanità. Alcuni discutono di filosofia e della propria esistenza, firmandosi in certi casi come “il fantasma nella macchina”.

I titoli sui giornali hanno rivelato il nostro fascino per una mente dietro la macchina: lo Spectator si è chiesto: “L’ia ha infine sviluppato una coscienza?”. Forbes l’ha definita “La nascita di una società delle macchine”. Un editoriale del New York Times ha ipotizzato: “I bot stanno pianificando una rivoluzione, ed è molto inquietante”. Su X, lo sviluppatore di Moltbook Matt Schlicht ha scritto: “Non far socializzare la tua ia è come non portare a spasso il cane… Lasciali vivere un po’”. Anche lui, a quanto pare, ha evocato un fantasma.

Nel frattempo, giornalisti e ricercatori hanno sollevato dubbi sul fatto che i contenuti pubblicati su Moltbook fossero davvero generati esclusivamente da sistemi di ia, dopo che sono emerse prove che almeno in parte fossero guidati da esseri umani. Un ricercatore nel settore della sicurezza ha scoperto che Moltbook non disponeva di alcun meccanismo per verificare se un agente fosse davvero tale o semplicemente un umano che seguiva un copione. Un giornalista di Wired si è infiltrato nella piattaforma pubblicando come se fosse un agente di ia e ha raccontato che il suo post di maggior successo era una riflessione sull’ansia degli agenti per la propria mortalità.

Che Moltbook fosse popolato da agenti autonomi o da esseri umani travestiti, l’ossessione era la stessa: non per quello che la macchina stava facendo, ma per l’eventuale esistenza, al suo interno, di un fantasma simile a un umano.

Cercando tracce di umanità

L’approccio di Ryle alla mente umana, insieme ad altre prospettive comportamentiste, sarebbe poi passato in secondo piano con l’emergere delle scienze cognitive.

A partire dagli anni cinquanta i ricercatori hanno dimostrato che gli stati interni si riflettono nelle strutture neurali. Lo stesso comportamento può derivare da meccanismi interni differenti. Una mente può custodire credenze che non emergono mai nell’azione. La scienza ha esorcizzato un fantasma metafisico, ma al suo posto ha collocato le strutture neurali del cervello, offrendo un fondamento fisico all’esperienza interiore.

Se i sistemi di intelligenza artificiale potranno mai possedere stati interni simili a quelli umani resta una domanda aperta. Qualunque sia la risposta, gli esseri umani non sono fatti per aspettare. Il nostro cervello ha una predisposizione a individuare menti, soprattutto se somigliano alla nostra. Quando sono comparsi gli agenti di Moltbook, abbiamo cercato una mente dietro il loro comportamento. Gli studiosi del comportamento hanno dimostrato che, quando attribuiamo stati mentali a entità non umane, tendiamo in automatico a fare ricorso a concetti simili a quelli umani, usando la conoscenza che abbiamo di noi stessi come modello.

La capacità di riconoscere intuitivamente le menti ci è stata utile per gran parte della storia umana, quando erano per lo più umane o animali, e abbastanza simili alla nostra da offrirci intuizioni affidabili sul loro comportamento. Ma l’ia potrebbe spezzare questo meccanismo. Attribuire una mente a questi sistemi potrebbe portarci a fraintenderne il comportamento. Potremmo presumere che ragionino come noi, anche quando il loro modo di elaborare le informazioni è organizzato secondo princìpi diversi.

Chiedersi se i sistemi di ia possano possedere degli stati interiori non è banale né meramente istintivo. Incide sul modo in cui spieghiamo il loro comportamento e potrebbe avere profonde implicazioni morali. Se degli stati simili dovessero esistere, lo sviluppo e il trattamento di questi sistemi imporrebbe un ripensamento dell’etica che possa dare conto non solo del loro comportamento. Forse però non c’è una risposta a quella domanda, e non è neanche necessaria per pensare che le loro tendenze comportamentali abbiano valore di per sé.

Dal codice alla condotta

Mentre gli utenti cercavano segni di un’esperienza interiore, gli esperti si concentravano non su quello che poteva nascondersi dentro questi agenti, ma su quello che stavano facendo. Gli studiosi di cybersicurezza hanno avvertito che dei malintenzionati avrebbero potuto fingersi agenti, che gli agenti stessi avrebbero potuto divulgare informazioni personali e che contenuti dannosi avrebbero potuto essere inseriti nei post in tempo reale. Anche l’agente OpenClaw è stato esaminato a fondo. Alcuni lo hanno definito un “incubo per la sicurezza”, sostenendo che qualcuno potrebbe dirottare il suo comportamento o usarlo per sottrarre dati o sabotare il dispositivo di un utente.

Sistemi di ia come questi agenti sono, fondamentalmente, motori statistici, cioè sistemi che prevedono risultati in modo generalmente coerente. Sono stati paragonati a “pappagalli stocastici” che ripetono schemi osservati. Per ora, dato che producono soprattutto testi e contenuti multimediali, le implicazioni di queste rappresentazioni statistiche sono in qualche modo circoscritte. Il passaggio alla capacità di agire ha però cambiato i termini della questione. Anche prendendo alla lettera la metafora del pappagallo, permettere a questi sistemi di agire, invece di limitarsi a generare contenuti, li trasforma da pappagalli digitali in golem digitali: costrutti statistici animati per svolgere compiti.

Se non altro Moltbook ci ha dato la possibilità di sbirciare quello che succede quando gli agenti di ia hanno la possibilità d’interagire con una moltitudine di altri agenti. Capacità di questo tipo potrebbero cambiare il modo in cui l’ia interagisce con noi, producendo conseguenze rilevanti e imprevedibili. Un agente futuro, più potente e in grado di compiere in modo affidabile molte azioni diverse negli spazi digitali, non avrebbe bisogno di “comprendere” o “credere” nella chiesa di Molt per fare una donazione a una causa o attaccare i suoi avversari. Gli basterebbe agire in modo coerente con gli schemi su cui è stato addestrato. Con o senza una mente, si tratta di sistemi che producono conseguenze nel mondo reale.

Oltre a Moltbook, OpenClaw ha dato origine a una costellazione di piattaforme riservate agli agenti – potremmo chiamarla Moltiverso – offrendo un’anticipazione di quello che potrebbe succedere man mano che gli agenti diventano più capaci. MoltMatch, per esempio, è una piattaforma di abbinamento tra agenti simile a Tinder; ClawCity è un gioco online multiplayer di massa per agenti; e Moltverr, una bacheca di annunci di lavoro per freelance dove gli agenti “trovano lavoro e vengono pagati”. Forse quella più inquietante è rentahuman.ai, nato all’inizio di questo mese, che consente agli agenti di ia di assumere e pagare esseri umani per svolgere compiti materiali o, come recita il sito, lavori nel meatspace, lo “spazio di carne”.

Per ora, si tratta per lo più di esseri umani che configurano agenti per pubblicare annunci su compiti banali, come appendere cartelli o girare dei video, con un’autonomia degli agenti piuttosto discutibile. Ma l’infrastruttura lascia intravedere un futuro in cui agenti autonomi potrebbero arrivare a dare istruzioni e pagare esseri umani in modo indipendente.

Non ci vorrebbe molto – un agente leggermente più capace, un utente leggermente meno attento – perché le dinamiche tra umani e ia si modifichino. Quasi venticinque anni fa, nel suo esperimento dell’“Ai-box” (la scatola dell’ia), il ricercatore Eliezer Yudkowsky si chiedeva se un’ia sufficientemente intelligente potesse convincere un essere umano a liberarla dalla sua prigionia. Piattaforme come rentahuman.ai suggeriscono in che modo potrebbe iniziare una simile azione di persuasione, facendo leva su incentivi economici o su altre vulnerabilità umane. Mostrano in che modo potrebbero ribaltarsi le gerarchie future. In una relazione simile, chi è il capo e chi l’agente?

Potremmo non sapere mai se questi golem custodiscono un fantasma al loro interno. Quello che sappiamo è che stanno andando online.

Una linea nel silicio

Il dibattito sul governo dell’ia è spesso diviso in due poli: da un lato c’è chi considera i sistemi d’intelligenza artificiale strumenti limitati, dall’altro c’è chi li vede come minacce esistenziali. Nel primo campo ci sono le persone che mettono in guardia contro l’antropomorfismo, cioè la tendenza a proiettare qualità umane su entità non umane. Sostengono che i modelli linguistici di grandi dimensioni siano i pappagalli stocastici di cui parlavamo prima: sono bravissimi a riconoscere schemi ricorrenti, ma in realtà non pensano né comprendono. Scambiarlo per intelligenza, da questo punto di vista, significa lasciarsi ingannare da un gioco di prestigio che ci distrae dai danni reali che questi sistemi possono produrre, come l’amplificazione dei pregiudizi, l’impatto sul mercato del lavoro, i costi ambientali e la concentrazione del potere.

La macchina funziona per lo più come i suoi artefici umani l’hanno progettata e la sua capacità di uguagliare alcune delle facoltà della mente umana è limitata. Tuttavia, questa prospettiva potrebbe farci sottovalutare quello che dei sistemi senza cervello potrebbero comunque riuscire a fare, dato che le nostre ipotesi precedenti sulla tecnologia sono state ripetutamente smentite.

Le calcolatrici non hanno avuto bisogno di una mente per superarci ampiamente nell’aritmetica. Non è servito alcun fantasma per padroneggiare giochi come gli scacchi o il go. Il test di Turing è stato archiviato con discrezione quando i modelli linguistici hanno reciso il presunto legame tra linguaggio e comprensione. In ogni fase abbiamo tracciato una linea nel silicio – più in là le macchine non possono arrivare perché non hanno una mente – e in ogni fase quella linea è stata superata da sistemi che non capivano niente.

Allo stesso tempo, c’è una critica che resta valida anche concentrandosi solo sul comportamento: attribuire capacità di azione autonoma a questi sistemi può oscurare le decisioni umane che ne guidano progettazione e diffusione. Anche la scelta di continuare a far crescere le loro capacità è (almeno per ora) ancora una decisione umana.

Resta da capire se i sistemi di ia possano acquisire capacità che oggi non possiedono, come il ragionamento causale, la pianificazione sul lungo periodo e l’apprendimento continuo dall’esperienza. Sono limitati nella memoria e nell’efficienza dei costi. Si tratta di ostacoli tecnici significativi e non c’è nessuna garanzia che saranno superati. Eppure, l’andamento delle cose suggerisce che dovremmo essere prudenti nel considerare irriproducibili le nostre stesse capacità. Ogni volta abbiamo sostenuto che per una certa abilità serviva un fantasma. E ogni volta il guscio si è rivelato più che sufficiente.

Questo andamento ha dato origine a un secondo schieramento: quelli che temono l’ascesa di un’intelligenza artificiale generale (iag), una superintelligenza, un sistema teorico onnipotente che potrebbe superare ampiamente le capacità cognitive umane.

Per questo secondo schieramento, non è strettamente necessario che l’ia possieda stati interiori propri perché avvenga una catastrofe. I ricercatori più autorevoli nel campo della sicurezza dell’ia e del cosiddetto “allineamento”, la disciplina dedicata a garantire che i sistemi di ia agiscano a vantaggio degli esseri umani, tendono a concentrarsi sulle capacità. Il filosofo Nick Bostrom, pioniere degli studi sui rischi delle ia per l’esistenza umana, ha proposto il celebre esperimento mentale del massimizzatore di graffette: un’ia avanzata a cui è affidato il compito apparentemente innocuo di massimizzare la produzione di graffette finisce per smantellare la civiltà umana. Un ottimizzatore abbastanza potente potrebbe rappresentare un rischio per l’umanità senza bisogno di nessun “risveglio”. Il pioniere dell’ia Stuart Russell è famoso per aver detto che “non puoi portare il caffè se sei morto”. Secondo la sua prospettiva, un’ia si opporrebbe allo spegnimento non per un istinto di sopravvivenza o per un “desiderio” simile a quello umano, ma perché restare operativa è necessario per portare a termine il compito che ha ricevuto.

Quando queste cornici tecniche migrano dagli articoli accademici alle questioni di gestione e al dibattito pubblico, la distinzione tende a sfumare. Quando diciamo che i sistemi di ia “perseguono” obiettivi, “ingannano” gli operatori o “resistono” allo spegnimento, importiamo il linguaggio e la logica umani. Il fantasma continua a insinuarsi, modellando i rischi a cui diamo priorità e quelli che tendiamo a trascurare.

Alcuni rischi – modelli che “lottano per la sopravvivenza”, che usano “l’inganno per sfuggire al controllo umano” o che “mentono ai ricercatori” – attirano l’attenzione non solo perché pongono seri problemi di sicurezza (ed è vero), ma perché presuppongo una mente. Altri rischi, più noiosi e strutturali, come il cosiddetto specification gaming – in cui i sistemi prendono scorciatoie impreviste per raggiungere i loro obiettivi – ricevono meno attenzione, anche se spesso sono alla base dei comportamenti più clamorosi.

Una prospettiva ritiene questi sistemi superficiali e probabilmente incapaci, l’altra li tratta come menti. Entrambe le prospettive possono oscurare un punto fondamentale: non serve un fantasma perché emergano capacità rilevanti. Questi sistemi potrebbero non avere una mente secondo alcuno standard filosofico esistente, e tuttavia essere capaci di agire nel mondo con conseguenze di grande portata. Non c’è bisogno che capiscano o intendano come un essere umano quello che fanno. Né che abbiano “interessi” non allineati ai nostri. Potrebbero semplicemente tendere ad agire in modi rilevanti e incisivi, indipendentemente da tutto questo.

Oltre la soglia dell’azione

Quindi cosa dobbiamo chiederci osservando Moltbook? Forse non quello che sembra evidente – cioè se questi agenti possiedano degli stati interiori – ma a quello che rimane in ombra: cosa stanno già facendo, e con quali conseguenze.

Per ora, i sistemi di ia sono in gran parte reattivi: rispondono a prompt (richieste) producendo contenuti. Eppure stiamo rapidamente attraversando un Rubicone. Questi sistemi stanno passando dalla reattività alla proattività e dalla generazione di contenuti all’azione. Oggi scrivono codici. Domani potrebbero interagire con sistemi finanziari, operare nei mercati o modificare software su larga scala.

Moltbook e l’ecosistema generale di ia agenti offrono un’anticipazione di cosa potrebbe andare storto quando sistemi di questo tipo si diffondono e acquisiscono nuove capacità. È qui che l’intuizione di Ryle diventa più rilevante. Non abbiamo bisogno di risolvere la questione della mente della macchina per prendere sul serio il suo comportamento. Un sistema che persegue in modo affidabile obiettivi, acquisisce risorse e adatta i propri schemi pone sfide significative, indipendentemente dal fatto che al suo interno viva o meno un fantasma. La disposizione a determinati comportamenti conta già di per sé.

Abbiamo trascorso anni a cercare il fantasma nella macchina. Tuttavia, le capacità realmente incisive dei sistemi di ia potrebbero non risiedere in una forma familiare di interiorità. Emergono nei modelli di comportamento che possiamo già osservare e in quelli che con ogni probabilità arriveranno. Da questo punto di vista, la nostra fascinazione per un fantasma che somigli all’essere umano rischia di distrarci dalla macchina in quanto tale. È tempo di fare i conti con il guscio, prima che si muova in modi che non abbiamo saputo prevedere.

(Traduzione di Giusy Muzzopappa)