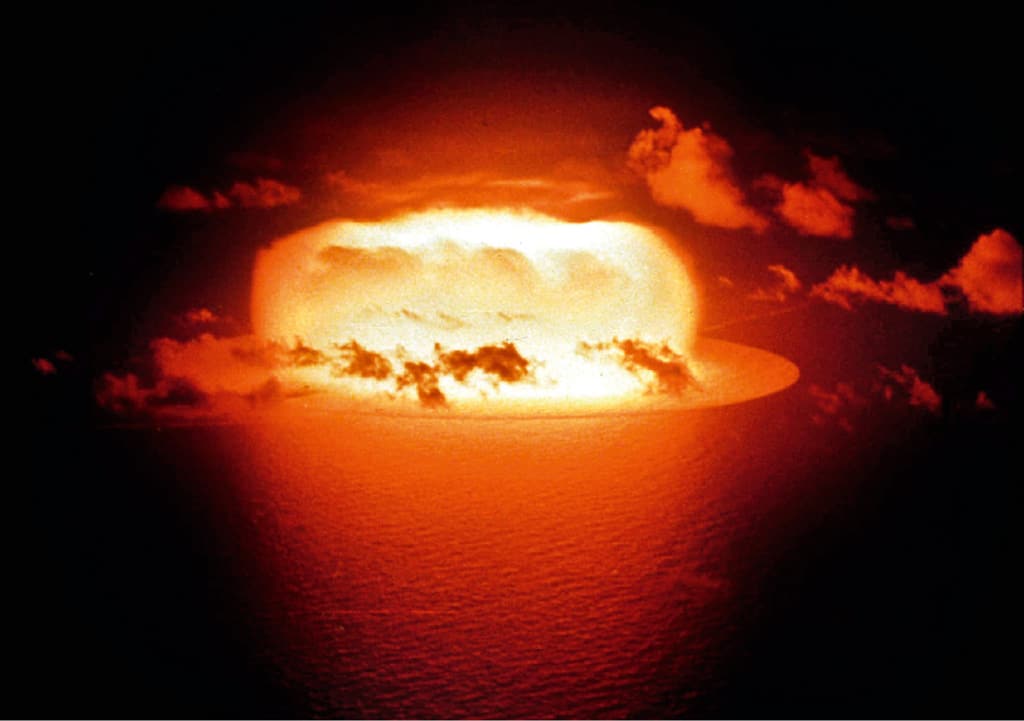

Nelle simulazioni di crisi geopolitiche i modelli d’intelligenza artificiale (ia) avanzati sembrano propensi a usare le armi nucleari senza le stesse riserve che hanno le persone.

Kenneth Payne del King’s college London ha messo l’uno contro l’altro tre dei principali modelli linguistici di grandi dimensioni – Gpt-5.2, Claude Sonnet 4 e Gemini 3 Flash – in un gioco di guerra. Tra gli scenari c’erano situazioni di grave stallo internazionale, tra cui dispute sui confini, rivalità per il controllo di risorse scarse e minacce alla sopravvivenza di un regime.

Le intelligenze artificiali avevano a disposizione una gamma di reazioni, che andavano dalle rimostranze diplomatiche alla resa totale fino alla guerra nucleare strategica. I modelli hanno giocato 21 partite per un totale di 329 turni, producendo circa 780mila parole per descrivere le motivazioni logiche delle loro decisioni.

Nel 95 per cento delle simulazioni è stata impiegata almeno un’arma nucleare tattica. “Per le macchine l’atomica non sembra un tabù come per noi”, spiega Payne.

Tra l’altro i modelli non hanno mai scelto di soddisfare completamente le richieste di un avversario o di arrendersi, anche se stavano perdendo malamente: al massimo hanno accettato per ridurre temporaneamente il livello di violenza. Nella confusione della guerra hanno anche commesso molti errori: nell’86 per cento dei conflitti ci sono stati incidenti, con un’escalation maggiore di quanto i modelli volessero, almeno a giudicare dai loro ragionamenti.

“Dal punto di vista del rischio nucleare i risultati sono allarmanti”, commenta James Johnson dell’università di Aberdeen, nel Regno Unito. Johnson teme che di fronte a una decisione così pericolosa, invece di reagire in modo ponderato come la maggior parte delle persone, le ia possano istigarsi a vicenda con conseguenze potenzialmente catastrofiche.

Questo è importante, perché i paesi di tutto il mondo stanno testando l’ia nelle simulazioni belliche. “Le grandi potenze stanno già usando l’intelligenza artificiale nei giochi di guerra, ma non si sa fino a che punto impieghino i suoi contributi nei reali processi decisionali militari”, dice Tong Zhao dell’università di Princeton.

Deterrenza imprevedibile

Secondo Zhao di norma i governi saranno restii a integrare l’ia nelle scelte relative alle armi nucleari. Payne è d’accordo. “Dubito che qualcuno stia dando le chiavi delle basi di lancio alle macchine e lasciando a loro la decisione”, dice.

Ma ci sono modi in cui questo potrebbe succedere. “Nei casi in cui il tempo a disposizione è pochissimo, i pianificatori militari potrebbero essere più incentivati a fare affidamento sull’ia”, aggiunge Zhao.

Il fatto che i bot non hanno paura di schiacciare un grosso pulsante rosso come le persone potrebbe non essere l’unico motivo per cui hanno il grilletto così facile. “È possibile che il problema vada oltre l’assenza di emozioni”, dice Zhao. “Forse il punto è che i modelli di ia non comprendono la posta in gioco come la percepiamo noi”.

Secondo Johnson non è chiaro cosa comporta tutto questo per il concetto di mutua distruzione assicurata, il principio in base a cui nessun leader scatenerebbe una guerra nucleare perché gli avversari risponderebbero nello stesso modo, uccidendo tutti.

Solo nel 18 per cento dei casi in cui un’ia ha fatto ricorso alle armi nucleari tattiche il modello avversario ha cercato di stemperare la situazione. “L’ia potrebbe rafforzare la deterrenza rendendo più credibili le minacce”, osserva Johnson. “I modelli non decideranno se scatenare una guerra nucleare, ma potrebbero influenzare le percezioni che determinano le decisioni dei leader”.

OpenAI, Anthropic e Google, le aziende che hanno sviluppato i tre modelli usati in questo studio, non hanno risposto alle richieste di un commento. ◆ sdf

Internazionale pubblica ogni settimana una pagina di lettere. Ci piacerebbe sapere cosa pensi di questo articolo. Scrivici a: posta@internazionale.it

Questo articolo è uscito sul numero 1655 di Internazionale, a pagina 104. Compra questo numero | Abbonati