Elon Musk, fondatore della Tesla e proprietario di Twitter, e Steve Wozniak, cofondatore della Apple, hanno firmato il 22 marzo una lettera aperta che invita a sospendere per sei mesi l’addestramento dei sistemi d’intelligenza artificiale. L’obiettivo è dare alla società il tempo di adattarsi a quella che i firmatari descrivono come “la bella stagione dell’intelligenza artificiale” e che, a loro avviso, porterà benefici all’umanità, a patto che siano creati dei protocolli di sicurezza. Un obiettivo lodevole, in questi sei mesi si potrebbe fare di meglio: ritirare dal dibattito pubblico l’etichetta abusata di “intelligenza artificiale”. Questa espressione appartiene alla stessa pattumiera della storia di cui fanno parte “cortina di ferro”, “teoria del domino” e “momento Sputnik”. È sopravvissuto alla guerra fredda grazie al suo fascino tra gli appassionati di fantascienza e gli investitori. Ma possiamo permetterci di ferire i sentimenti di queste persone.

In realtà quello che oggi chiamiamo intelligenza artificiale non è né artificiale né intelligente. I primi sistemi di intelligenza artificiale erano caratterizzati da regole e programmi, per cui parlare di artificialità era giustificato. Ma quelli di oggi, compreso ChatGpt, che ha entusiasmato tutti, traggono la loro forza non da regole astratte, ma dagli esseri umani: artisti, musicisti, programmatori e scrittori il cui lavoro viene sfruttato in nome della salvezza della civiltà. Nella migliore delle ipotesi stiamo parlando di “intelligenza non artificiale”. Per quanto riguarda la parte dell’intelligenza, la guerra fredda ha finanziato i primi studi su questi programmi e ha lasciato un’impronta pesante sul nostro modo di concepirli, immaginando di usarli soprattutto sui campi di battaglia. Per esempio, il punto di forza della moderna intelligenza artificiale è la cosiddetta corrispondenza dei modelli (un metodo per individuare schemi negli insiemi di dati). Non c’è da stupirsi, visto che uno dei primi usi militari delle reti neurali, la tecnologia alla base di ChatGpt, è stato quello d’individuare le navi nelle foto aeree.

Il motivo per cui programmi come ChatGpt possono fare qualcosa di creativo è che i loro strumenti d’addestramento sono stati prodotti da esseri umani con le loro emozioni

Tuttavia, molti hanno sottolineato che l’intelligenza non è solo una questione di corrispondenza dei modelli. Altrettanto importante è la capacità di fare delle generalizzazioni. L’opera d’arte Fontana di Marcel Duchamp del 1917 ne è un esempio lampante: prima di quell’opera un orinatoio era solo un orinatoio. Ma con un cambio di prospettiva, Duchamp lo trasformò in un’opera d’arte. In quel momento aveva compiuto una generalizzazione sull’arte. Quando generalizziamo, l’emozione scavalca le classificazioni radicate e apparentemente razionali di idee e oggetti quotidiani, e sospende le operazioni consuete di corrispondenza dei modelli. Una cosa che si preferisce non fare nel bel mezzo di una guerra.

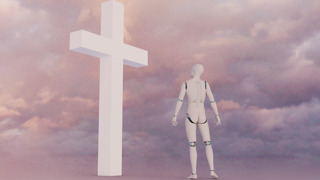

L’intelligenza umana non è unidimensionale. È il prodotto di quello che lo psicoanalista cileno Ignacio Matte Blanco ha chiamato bi-logica. La bi-logica vivacizza la noiosa corrispondenza dei modelli, mentre la generalizzazione creativa ci permette di raggruppare cose banali in modi nuovi. Lo facciamo tutti, non solo Duchamp. L’intelligenza artificiale non ci arriverà mai, perché le macchine non possono provare emozioni o avere un senso della storia, delle ferite o della nostalgia.

ChatGpt ha la sua utilità. È un motore di previsione che può anche funzionare da enciclopedia. Alla domanda su cos’abbiano in comune un portabottiglie, una pala da neve e un orinatoio, ha risposto correttamente che sono tutti oggetti di uso quotidiano che Duchamp ha trasformato in arte. Ma quando gli è stato chiesto quali oggetti di oggi Duchamp avrebbe trasformato in arte, ha risposto smartphone, monopattini e mascherine. Non c’è traccia di bi-logica. È una macchina statistica, ben gestita ma noiosa.

Usare un’espressione imprecisa e obsoleta come “intelligenza artificiale” rischia di convincerci che il mondo funzioni davvero con una logica unica: quella di un razionalismo cognitivo. Molti nella Silicon valley già la pensano così e sono impegnati a ricostruire la realtà sulla base di questa convinzione. Ma il motivo per cui programmi come ChatGpt possono fare qualcosa di vagamente creativo è che sono addestrati su materiali prodotti da esseri umani con le loro emozioni e le loro ansie. Se si vuole che questa creatività continui, dovremmo finanziare l’arte, la narrativa e la storia, non solo i centri di calcolo.

Ma il mondo va in tutt’altra direzione. La scelta di non mandare in pensione espressioni come “intelligenza artificiale” potrebbe rendere invisibile il lavoro creativo, rendendo tutto più prevedibile e stupido. Così, invece di passare sei mesi a controllare gli algoritmi in attesa della bella stagione dell’intelligenza artificiale, faremmo meglio a rileggere Sogno di una notte di mezza estate di William Shakespeare. Sarà molto più utile, se si vuole rendere il mondo un posto più intelligente. ◆ ff

Internazionale pubblica ogni settimana una pagina di lettere. Ci piacerebbe sapere cosa pensi di questo articolo. Scrivici a: posta@internazionale.it

Questo articolo è uscito sul numero 1506 di Internazionale, a pagina 38. Compra questo numero | Abbonati